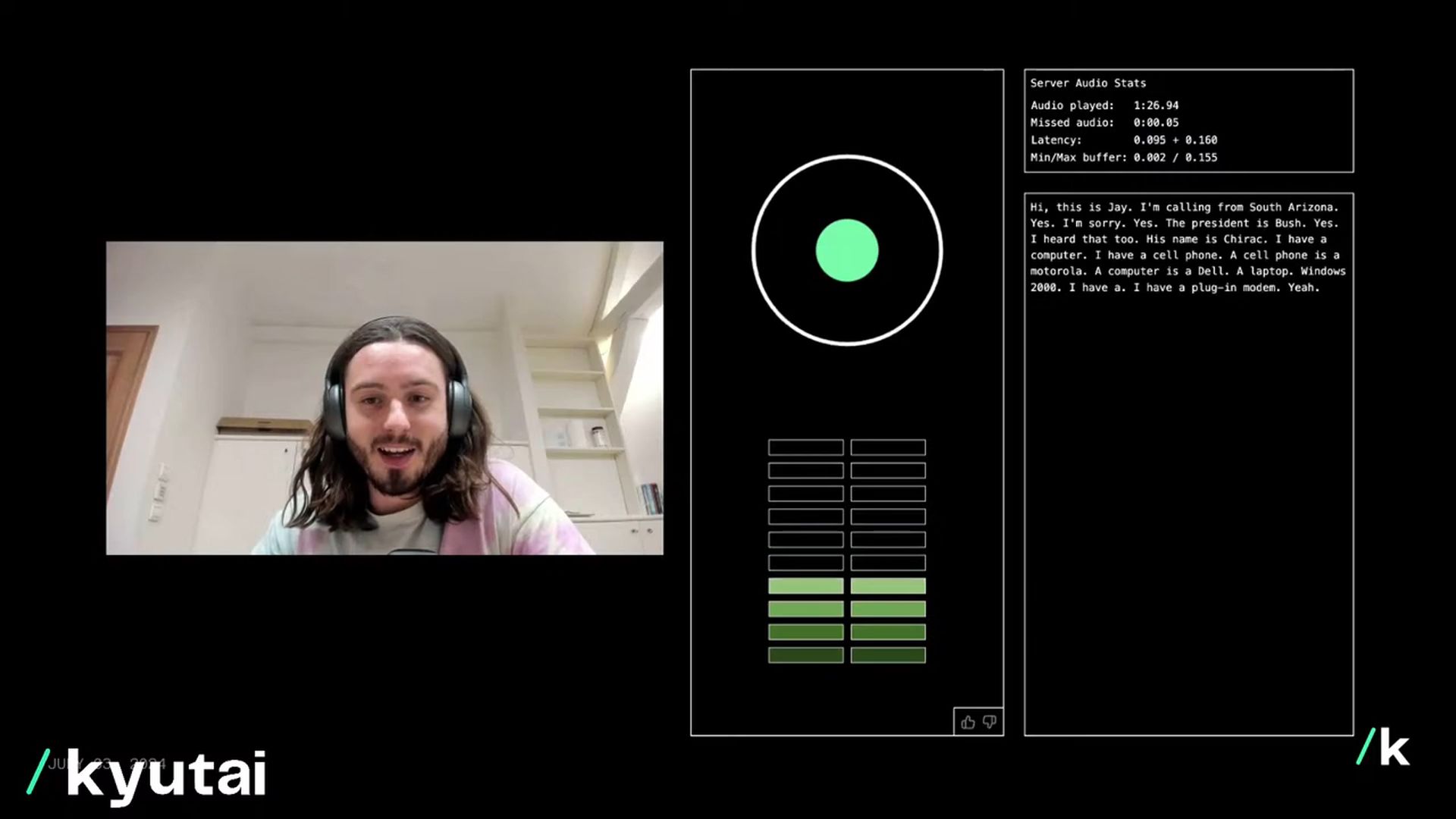

Kyutai, un laboratorio sin fines de lucro dedicado a promover la investigación abierta en inteligencia artificial (IA), ha logrado avances significativos con su última innovación, Moshi Chat. Este modelo de base multimodal nativo en tiempo real de vanguardia representa un logro notable en la tecnología de IA. La introducción de Moshi Chat por parte de Kyutai ha llamado la atención por sus impresionantes capacidades, en particular en los ámbitos de escuchar y hablar simultáneamente. A diferencia de los modelos de IA tradicionales, Moshi Chat está diseñado para comprender y expresar emociones, lo que hace que las interacciones con él sean más naturales y atractivas.

Con sus características únicas y disponibilidad de código abierto, Moshi Chat se destaca como pionero en el desarrollo de IA.

El desarrollo de Moshi Chat es un testimonio del compromiso de Kyutai con la transparencia y la innovación colaborativa. La capacidad del modelo para manejar dos transmisiones de audio simultáneamente—escuchar y hablar en tiempo real—lo distingue de otros modelos de IA.

Esta capacidad está respaldada por un sólido proceso de preentrenamiento conjunto sobre una combinación de datos de texto y audio, utilizando datos de texto sintéticos de Helium, un Modelo de lenguaje de 7 mil millones de parámetros desarrollado por KyutaiEstos avances en la tecnología de IA son el resultado de una investigación rigurosa y de un ajuste preciso, cuyo objetivo es lograr un rendimiento uniforme y eficiente.

La tecnología de Kyutai Moshi Chat

La característica destacada de Moshi Chat es su Capacidad de interacción en tiempo reallo que le permite escuchar y responder simultáneamente. Esto se logra mediante un entrenamiento previo conjunto con una combinación de datos de texto y audio, lo que garantiza que el modelo pueda mantener un flujo fluido de información textual y auditiva. La base de las capacidades de procesamiento del habla de Moshi Chat es el modelo Helium, un modelo de lenguaje de 7 mil millones de parámetros que sirve como columna vertebral para esta innovadora tecnología.

De acuerdo con la Discurso inaugural de Kyutai Moshi Chat en YouTubeEl proceso de ajuste de Moshi Chat implicó un Amplio conjunto de datos de 100.000 conversaciones sintéticas de “estilo oral”Estas conversaciones se convirtieron utilizando tecnología de texto a voz (TTS), similar a Murf IAlo que permite que el modelo genere y comprenda el habla con una precisión notable. El motor TTS, que admite 70 emociones y estilos diferentes, se afinó utilizando 20 horas de audio grabado por locutores autorizados. Este enfoque meticuloso del entrenamiento ha dado como resultado un modelo que No sólo entiende el lenguaje hablado sino que también transmite emociones y maticeshaciendo que las interacciones sean más naturales y atractivas.

El compromiso de Kyutai con el uso responsable de la IA es evidente en la incorporación de marcas de agua para detectar el audio generado por la IA. Esta función, aún en desarrollo, subraya la importancia de las consideraciones éticas en el desarrollo de la IA. Además, la decisión de lanzar Moshi Chat como un proyecto de código abierto destaca la dedicación de Kyutai a fomentar una Entorno colaborativo dentro de la comunidad de IA.

Proceso de entrenamiento y puesta a punto de Moshi AI

El desarrollo de Moshi Chat implicó un riguroso proceso de entrenamiento y ajuste para garantizar su alto nivel de rendimiento. El modelo se entrenó desde cero utilizando el modelo de lenguaje de texto base Helium 7B, que luego se entrenó en conjunto con códecs de texto y audio.

El códec de voz, basado en el modelo Mimi interno de Kyutai, cuenta con una Factor de compresión 300xlo que ayuda a preservar la calidad del audio y al mismo tiempo reducir el tamaño de los datos.

El proceso de ajuste de Moshi Chat implicó anotar 100.000 transcripciones muy detalladas con emoción y estiloEstas anotaciones permiten que el modelo comprenda y transmita una amplia gama de emociones, lo que hace que las interacciones con él sean más realistas y atractivas. El motor de texto a voz, que admite 70 emociones y estilos diferentes, fue Afinado con 20 horas de audio grabado por un Talento de voz con licencia llamado Alice.

El enfoque de Kyutai en la adaptabilidad es evidente en Moshi Chat Capacidad de ser ajustado con menos de 30 minutos de audioEsta función permite a los usuarios personalizar el modelo para que se adapte a necesidades específicas, ya sea para investigación, aprendizaje de idiomas u otras aplicaciones. La implementación del modelo muestra su eficiencia y versatilidad. Manejo de dos tamaños de lotes con 24 GB de VRAM y compatibilidad con múltiples backendsSe prevé que las optimizaciones en el código de inferencia, como el almacenamiento en caché KV mejorado y el almacenamiento en caché de indicaciones, mejoren aún más el rendimiento de Moshi Chat.

Tecnología para todos de Kyutai Labs

Moshi Chat no es solo una maravilla tecnológica, sino también muy accesible. Kyutai ha desarrollado una variante más pequeña del modelo que puede ejecutarse en una MacBook o en una GPU de consumo masivo, lo que la pone a disposición de una gama más amplia de usuarios.

La eficiencia del modelo se demuestra aún más con su implementación en plataformas como Scaleway y Cara abrazadadonde maneja dos tamaños de lotes con 24 GB de VRAM y admite varios backends, incluidos CUDA, Metal y CPU.

La voz del modelo, entrenada con datos sintéticos generados por un modelo TTS independiente, alcanza una impresionante latencia de extremo a extremo de 200 milisegundos. Esta baja latencia es crucial para las interacciones en tiempo real, lo que permite que Moshi Chat responda casi instantáneamente a las entradas del usuario. La combinación de técnicas de entrenamiento avanzadas y código de inferencia optimizado, desarrollado con Rust, contribuye al rendimiento superior del modelo. También se espera que el almacenamiento en caché de KV mejorado y el almacenamiento en caché de indicaciones mejoren aún más la eficiencia del modelo.

La demostración publicada por Yann Le Cun muestra lo bien que funciona este nuevo modelo de IA.

Una demostración en vivo de Moshi desde https://t.co/TngVXgSjzX https://t.co/qftjudOq1k

— Yann LeCun (@ylecun) 3 de julio de 2024

De cara al futuro, Kyutai tiene planes ambiciosos para Moshi Chat. El equipo pretende publicar un informe técnico completo y versiones abiertas del modelo, que incluyan la base de código de inferencia, el modelo 7B, el códec de audio y la pila optimizada completa. Las futuras iteraciones de Moshi Chat, como las versiones 1.1, 1.2 y 2.0, incorporarán los comentarios de los usuarios para refinar y mejorar las capacidades del modelo.

La licencia permisiva de Kyutai tiene como objetivo fomentar la adopción generalizada y la innovación, garantizando que los beneficios de Moshi Chat sean accesibles para una audiencia diversa.

Cómo utilizar Moshi Chat

Los usuarios pueden y se les anima a hacerlo: Pruebe Moshi Chat en línea a través del sitio web de Kyutai. Una vez ahí:

- Introduce tu correo electrónico

- Haga clic en “Unirse a la cola”

- Empieza a hablar

Ya sea discutiendo temas cotidianos o explorando temas más complejos, los usuarios pueden interactuar con Moshi Chat de forma natural, beneficiándose de sus capacidades avanzadas de reconocimiento y síntesis de voz.

Crédito de la imagen destacada: Kyutai/YouTube