OpenAI, la empresa detrás de ChatGPT, está ampliando sus esfuerzos para asegurar una potencia informática confiable y rentable para sus modelos de IA. Al desarrollar silicio personalizado, OpenAI pretende reducir la dependencia de proveedores externos como NVIDIA, cuyas GPU dominan el mercado de chips de IA. De acuerdo a Reuters OpenAI se ha asociado con Broadcom y ha asegurado capacidad de fabricación con Taiwan Semiconductor Manufacturing Company (TSMC), al tiempo que incorpora chips AMD en su configuración de Microsoft Azure.

OpenAI construirá chips de IA personalizados con Broadcom y TSMC

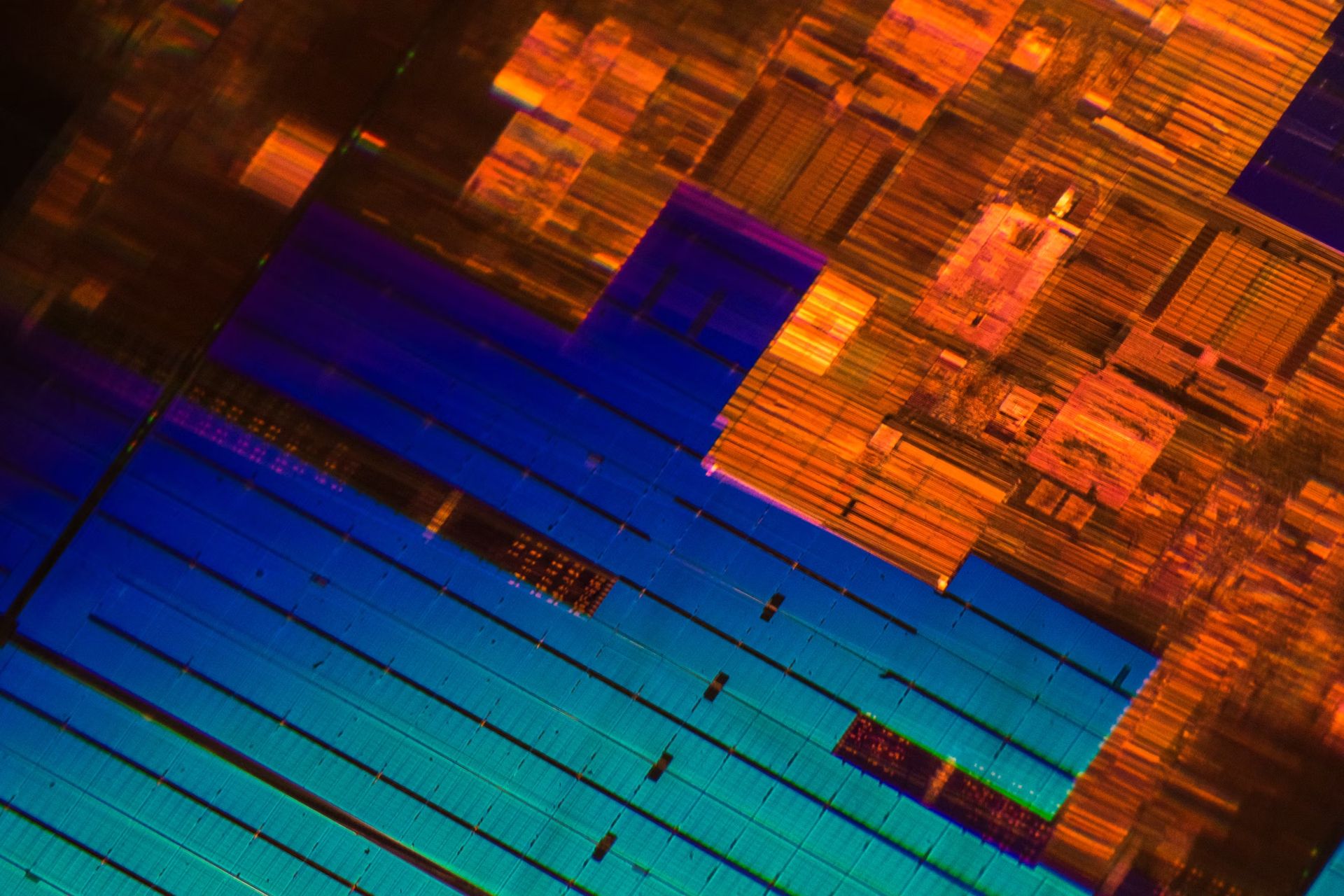

El viaje de OpenAI hacia el desarrollo de sus propios chips de IA comenzó con la reunión de un equipo de unas 20 personas, incluidos ingenieros de primer nivel que anteriormente trabajaron en las Unidades de procesamiento tensorial (TPU) de Google. Este equipo interno de chips, dirigido por ingenieros experimentados como Thomas Norrie y Richard Ho, está trabajando estrechamente con Broadcom para diseñar y producir silicio personalizado que se centrará en cargas de trabajo de inferencia. Se espera que los chips sean fabricados por TSMC, la fundición de semiconductores más grande del mundo, a partir de 2026.

El objetivo detrás del desarrollo interno de silicio es doble: asegurar un suministro estable de chips de alto rendimiento y gestionar los crecientes costos asociados con las cargas de trabajo de IA. Si bien la demanda de chips de entrenamiento es actualmente mayor, los expertos de la industria anticipan que la necesidad de chips de inferencia superará a los chips de entrenamiento a medida que más aplicaciones de IA lleguen a la etapa de implementación. La experiencia de Broadcom para ayudar a perfeccionar los diseños de chips para la producción en masa y proporcionar componentes que optimicen el movimiento de datos lo convierte en un socio ideal para este ambicioso proyecto.

OpenAI había considerado anteriormente construir sus propias fundiciones de chips, pero finalmente decidió abandonar esos planes debido a los inmensos costos y tiempo requeridos. En cambio, OpenAI se centra en diseñar chips personalizados y depende de TSMC para la fabricación.

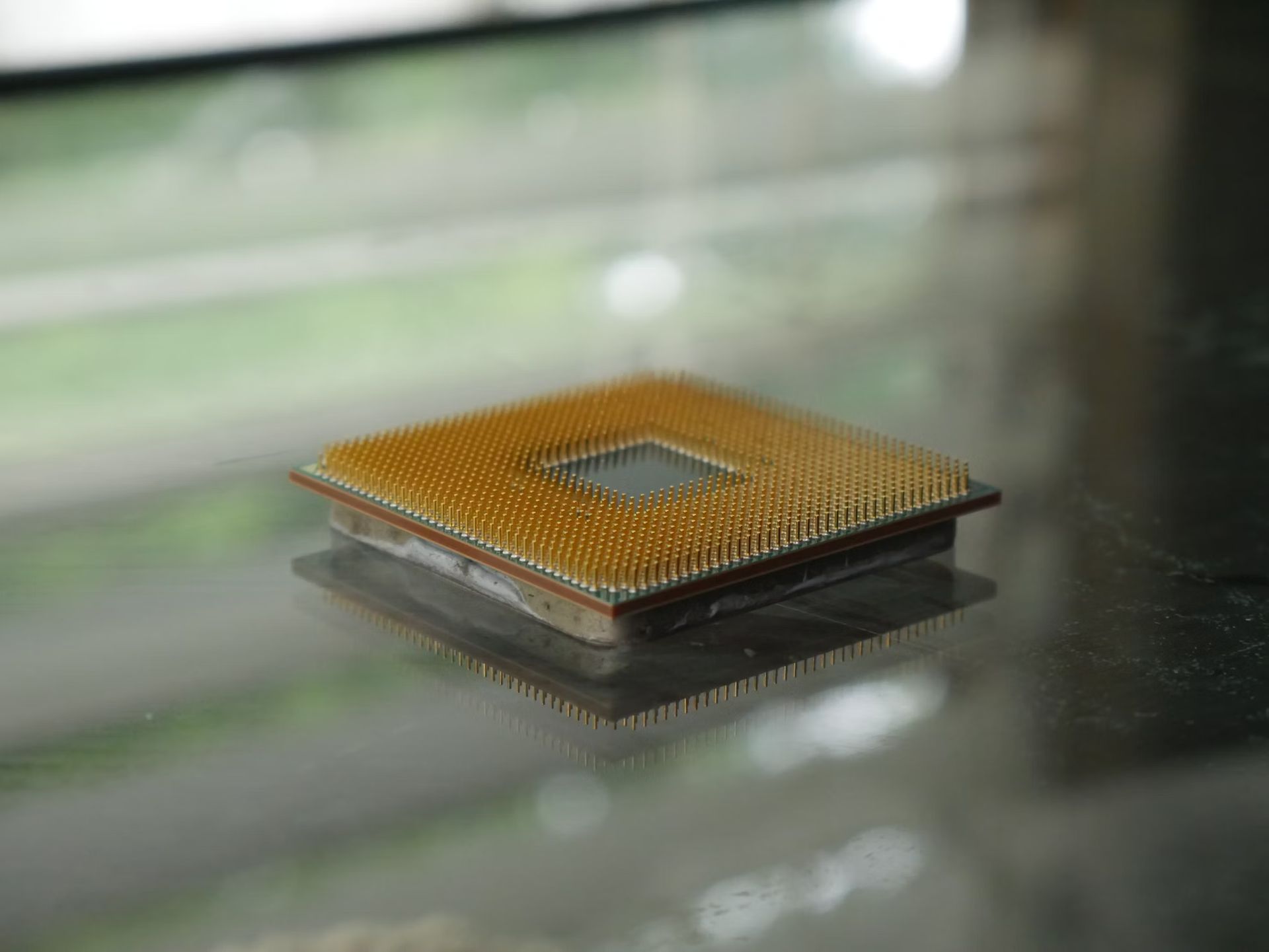

Incorporación de chips AMD para la diversificación

Además de su asociación con Broadcom, OpenAI también está incorporando la nueva tecnología de AMD. MI300X chips en su configuración de Microsoft Azure. AMD introdujo estos chips el año pasado como parte de su estrategia de expansión de centros de datos, con el objetivo de capturar parte de la participación de mercado que actualmente posee NVIDIA. La inclusión de chips AMD permitirá a OpenAI diversificar su suministro de chips, reduciendo su dependencia de un único proveedor y ayudando a gestionar los costos de manera más efectiva.

Los chips MI300X de AMD son parte de su intento de competir con NVIDIA, que actualmente posee más del 80% de la participación de mercado en hardware de IA. Los chips MI300X están diseñados para soportar cargas de trabajo de IA, particularmente en inferencia y entrenamiento de modelos. Al agregar chips AMD a su infraestructura, OpenAI espera aliviar algunas de las limitaciones de suministro que ha enfrentado con las GPU NVIDIA, que han tenido una gran demanda y han estado sujetas a escasez.

Este movimiento estratégico también es una respuesta al aumento de los costos informáticos, que se han convertido en un desafío importante para OpenAI. La empresa ha estado lidiando con altos gastos en hardware, electricidad y servicios en la nube, lo que ha llevado a pérdidas proyectadas de 5 mil millones de dólares este año. Reducir su dependencia de un único proveedor como NVIDIA, que ha estado aumentando sus precios, podría ayudar a OpenAI a gestionar mejor estos costos y continuar desarrollando sus modelos de IA sin retrasos o interrupciones significativas.

El camino por delante

A pesar del ambicioso plan para desarrollar chips personalizados, OpenAI tiene importantes desafíos por delante. Crear una solución de silicio interna requiere tiempo y dinero, y no se espera que los primeros chips diseñados a medida estén en producción hasta 2026. Este cronograma coloca a OpenAI detrás de algunos de sus mayores competidores como Google, Microsoft y Amazon, que ya han hizo un progreso sustancial en el desarrollo de su propio hardware de IA personalizado.

La asociación con Broadcom y TSMC representa un importante paso adelante, pero también pone de relieve las dificultades a las que se enfrentan las empresas que intentan entrar en el mercado de los chips. La fabricación de chips de IA de alto rendimiento requiere una experiencia sustancial, instalaciones de producción avanzadas y una inversión considerable. TSMC, como socio fabricante, desempeñará un papel clave a la hora de determinar el éxito de esta empresa. El cronograma para la producción de chips aún podría cambiar, dependiendo de factores como la complejidad del diseño y la capacidad de fabricación.

Otro desafío radica en la adquisición de talento. OpenAI es cauteloso a la hora de robar talento a NVIDIA, ya que quiere mantener una buena relación con el fabricante de chips, especialmente porque todavía depende en gran medida de NVIDIA para sus modelos de IA de generación actual. Se espera que los chips Blackwell de NVIDIA sean cruciales para los próximos proyectos de IA, y mantener una relación positiva es esencial para el acceso continuo de OpenAI a estas GPU de vanguardia.

Por qué OpenAI necesita silicio personalizado

El principal impulsor de la iniciativa de chips personalizados de OpenAI es el costo. Entrenar e implementar grandes modelos de IA como GPT-4 requiere una enorme potencia informática, lo que se traduce en elevados gastos de infraestructura. Se proyecta que los costos de computación anuales de OpenAI serán uno de sus mayores gastos, y la compañía espera una pérdida de 5 mil millones de dólares este año a pesar de generar 3,7 mil millones de dólares en ingresos. Al desarrollar sus propios chips, OpenAI espera controlar estos costos, dándole una ventaja competitiva en el saturado mercado de la IA.

El silicio personalizado también ofrece beneficios de rendimiento. Al adaptar los chips específicamente a las necesidades de la inferencia de IA, OpenAI puede optimizar el rendimiento, mejorar la eficiencia y reducir la latencia. Esto es particularmente importante para brindar respuestas de alta calidad en tiempo real en productos como ChatGPT. Si bien las GPU de NVIDIA tienen una gran capacidad, el hardware diseñado a medida puede proporcionar una optimización más específica, lo que podría conducir a mejoras significativas en el rendimiento y la rentabilidad.

El enfoque de combinar soluciones de chips internos y externos proporciona a OpenAI una mayor flexibilidad en la forma de escalar su infraestructura. Al trabajar con Broadcom en diseños personalizados y al mismo tiempo incorporar GPU AMD y NVIDIA, OpenAI se está posicionando para afrontar mejor los desafíos de la alta demanda y las limitaciones de la cadena de suministro. Este enfoque diversificado ayudará a la empresa a adaptarse a las condiciones cambiantes del mercado y garantizará que tenga los recursos informáticos necesarios para seguir superando los límites de la IA.

Crédito de la imagen destacada: Andrew Neel/Unsplash