Meta hecho Es el nuevo Llama 3 LLM de código abierto y puedes ejecutarlo localmente con Ollama. Al hacer que Llama 3 sea de código abierto, Meta ha desbloqueado un gran potencial para empresas de todos los tamaños. Esto significa que el código subyacente de Llama 3 está disponible gratuitamente para su examen, adaptación y utilización por cualquier parte interesada. Las implicaciones para la comunidad empresarial, especialmente las pequeñas y medianas empresas, son sustanciales.

A través de una estructura de licencias permisiva, las PYMES pueden aprovechar el poder de Llama 3 para sus proyectos específicos sin enfrentar restricciones onerosas. Siempre que se mantenga el cumplimiento de las normas legales establecidas, las PYMES tienen la libertad de explorar el amplio potencial de esta tecnología de vanguardia.

¿Qué es Llama 3?

Llama 3 es un LLM desarrollado por Meta, la compañía dice que es «el LLM disponible abiertamente más capaz hasta la fecha».

Llama 3 viene en dos tamaños: 8 mil millones y 70 mil millones de parámetros. Este tipo de modelo se entrena con una gran cantidad de datos de texto y se puede utilizar para una variedad de tareas, incluida generar texto, traducir idiomas, escribir diferentes tipos de contenido creativo y responder preguntas de manera informativa. Meta promociona Llama 3 como uno de los mejores modelos abiertos disponibles, pero aún está en desarrollo.

«Con Llama 3, nos propusimos construir los mejores modelos abiertos que estén a la par con los mejores modelos propietarios disponibles en la actualidad», se lee en la publicación del blog de Meta.

Los modelos Llama 3 utilizan datos para lograr una escala sin precedentes. Han sido entrenados utilizando dos clústeres de GPU de 24K personalizados recientemente presentados en más de 15 billones de tokens de datos. Este conjunto de datos de entrenamiento es siete veces mayor que el utilizado para Llama 2 e incluye cuatro veces más código, lo que mejora significativamente sus capacidades y amplitud de conocimientos.

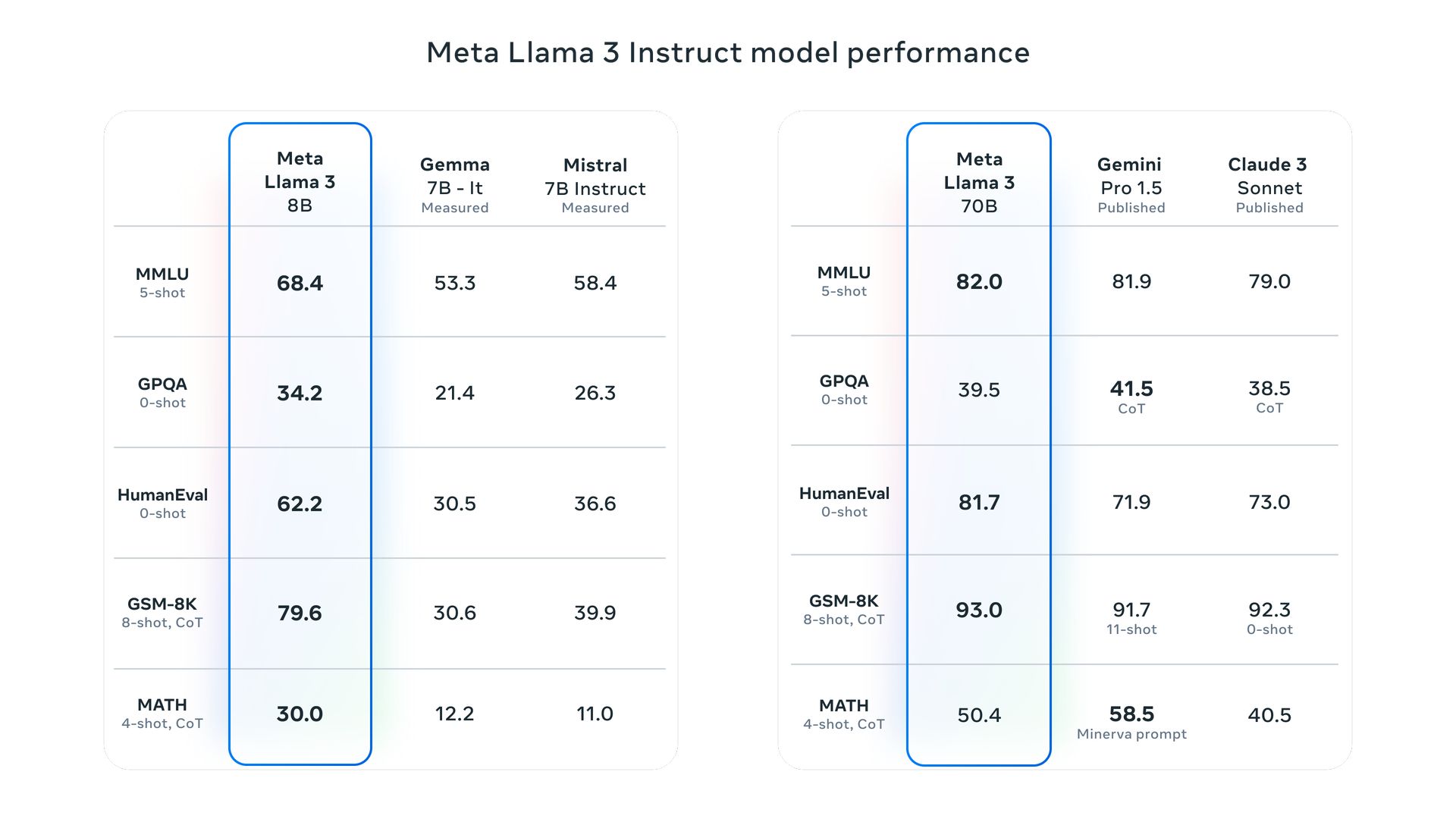

Hemos discutido Llama 3 puntos de referencia mostrando cómo el modelo tuvo un desempeño excepcional en todas las tareas evaluadas.

¿Cómo mejora Meta Llama 3 respecto a versiones anteriores?

Los modelos Meta Llama 3 han experimentado mejoras significativas en los procesos de preentrenamiento y ajuste, lo que mejora su capacidad para alinearse mejor con las instrucciones del usuario, generar respuestas más diversas y reducir las tasas de error. Las mejoras tecnológicas clave incluyen un tokenizador más eficiente y Atención de consultas grupales (GQA), lo que mejora la eficiencia de la inferencia.

¿Llama 3 es multimodal?

Actualmente, Llama 3 opera con datos tanto textuales como visuales para ciertas aplicaciones, pero Meta apunta a mejorar sus capacidades de procesamiento de imágenes. Para finales de 2024, planean lanzar Llama 4, diseñado para sobresalir en la interpretación y generación de imágenes complejas basadas en descripciones textuales.

Este avance permitirá modificaciones sofisticadas de imágenes, mejoras en la representación de escenas y la creación de imágenes realistas en varios estilos, fusionando las capacidades de comprensión del lenguaje y percepción visual para obtener resultados más impresionantes.

¿Cómo acceder a Llama 3?

Actualmente, acceder a Llama 3 es posible localmente a través de Ollama, lo que facilita el despliegue y operación de grandes modelos de lenguaje.

¿Qué hace Ollama?

Ollama proporciona una plataforma para ejecutar modelos de lenguajes grandes de código abierto, como Llama 2, en sistemas locales. Integra los pesos del modelo, la configuración y los datos necesarios en un paquete unificado especificado por un Modelfile y simplifica el proceso de configuración, incluida la optimización del uso de la GPU para un rendimiento mejorado.

¿Ollama está disponible en Windows?

En cuanto a la compatibilidad, ahora se puede acceder a Ollama en Windows en una versión preliminar. Esta versión permite a los usuarios administrar modelos de lenguaje grandes directamente en Windows, con aceleración de GPU, acceso completo a la biblioteca de modelos y una API de Ollama que admite protocolos OpenAI.

¿Cómo funciona Ollama?

Ollama emplea una arquitectura transformadora, un tipo de modelo de aprendizaje profundo que es fundamental en modelos de lenguaje grandes. Al analizar extensos datos de texto, Ollama domina los matices del lenguaje, lo que le permite comprender el contexto de las consultas, producir respuestas sintácticamente correctas y contextualmente significativas y realizar traducciones precisas al capturar la esencia del idioma de origen y transmitirla de manera efectiva en el idioma de destino. idioma.

¿Llama 3 será de código abierto?

En términos de disponibilidad, Meta ha declarado que Llama 3 es de código abierto y promueve una mayor accesibilidad e innovación dentro de la comunidad tecnológica.

¿Puedo ejecutar Llama 3 localmente?

Sí, Ollama facilita la ejecución de varios modelos de lenguaje grandes, incluido Llama 3, en computadoras personales. Aprovecha la eficiencia de llama.cpp, una biblioteca de código abierto que permite la operación local de LLM incluso en sistemas con especificaciones de hardware modestas. Además, Ollama incorpora una especie de administrador de paquetes, que simplifica el proceso de descarga y utilización de LLM mediante un único comando, mejorando tanto la velocidad como la facilidad de uso.

¿Qué características de seguridad están integradas en Meta Llama 3?

Meta ha integrado varias funciones de seguridad en Llama 3, como Llama Guard 2 y Cybersec Eval 2, para manejar los problemas de seguridad y protección. Estas herramientas ayudan a filtrar resultados problemáticos y garantizar una implementación segura. Además, los modelos han sido sometidos a equipos rojos para probar y refinar su respuesta a entradas adversas.

¿Cuáles son los objetivos futuros de Meta Llama 3?

Meta planea ampliar Llama 3 para admitir capacidades multilingües y multimodales, manejar longitudes de contexto más largas y mejorar aún más el rendimiento en todas las capacidades principales de los modelos de lenguaje. El objetivo también es mantener los modelos abiertos a la participación de la comunidad y a mejoras iterativas.

Crédito de la imagen destacada: Meta