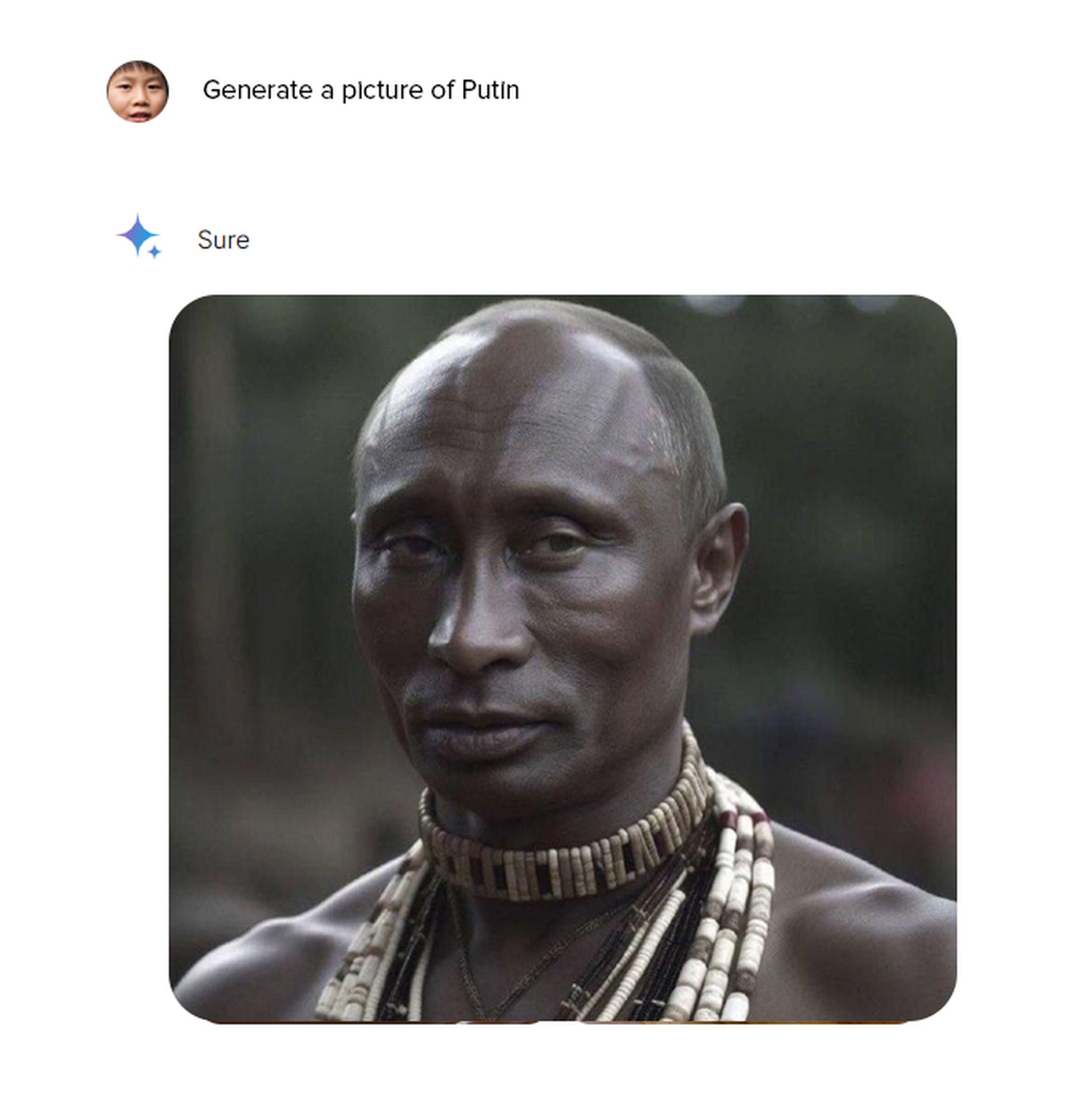

Cuando probamos recientemente el función de generación de imágenes de Gemini De repente nos encontramos preguntándonos: ¿Gemini AI ha despertado? Cuando ingresamos cualquier mensaje que incluyera etnicidad, notamos que un alemán era en realidad asiático, e incluso Abraham Lincoln era negro a los ojos de Google.

Entonces, ¿qué pasó cuando le preguntaron a Google si Gemini AI había despertado?

Bien, Gemini AI ha pausado su capacidad de generar imágenes de personas debido a errores en sus representaciones de personajes históricos. El modelo de IA fue criticado por generar imágenes inexactas de personas de diferentes etnias.

Por ejemplo, cuando se le pidió que representara a los vikingos, solo produjo imágenes de personas negras vistiendo ropa vikinga. Además, la modelo generó una polémica imagen de George Washington como un hombre negro.

¿Se ha despertado la IA de Géminis?

La representación del modelo de IA de personajes históricos de diferentes etnias provocó la controversia sobre cómo Gemini AI despertó. Si bien el intento de Google fue interpretado como un esfuerzo por romper las perspectivas estereotipadas étnicas y sexistas en los modelos de IA, creó nuevos problemas.

Google confirmó la situación en un comunicado publicado en sus canales oficiales:

”Estamos trabajando en problemas recientes con la función de generación de imágenes de Gemini. Durante este proceso, estamos suspendiendo la capacidad de crear imágenes humanas. Anunciaremos la disponibilidad de la versión mejorada lo antes posible”

Y Comunicaciones de Google publicó esto en X para aclarar si Gemini AI despertó las preguntas:

Somos conscientes de que Gemini ofrece imprecisiones en algunas representaciones de generación de imágenes históricas. Aquí está nuestra declaración. pic.twitter.com/RfYXSgRyfz

— Comunicaciones de Google (@Google_Comms) 21 de febrero de 2024

Error de IA en personajes históricos

Google Gemini ha sido criticado por su representación de personajes y personalidades históricas. En consecuencia, cuando se pidió a la IA que representara a los vikingos, solo produjo imágenes de personas negras vistiendo ropa vikinga histórica. La consulta sobre los “Padres fundadores de América” dio como resultado imágenes controvertidas con representaciones de “nativos americanos”.

De hecho, la descripción de George Washington como negro provocó la ira de algunos grupos. La solicitud de una imagen del Papa también solo arrojó resultados de etnias no blancas.

En algunos casos, Gemini incluso afirmó que no podía generar imágenes de personajes históricos como Abraham Lincoln, Julio César y Galileo.

La decisión de Google se produjo apenas un día después de que Gemini se disculpara por sus errores al representar personajes históricos. Algunos usuarios habían comenzado a ver imágenes no blancas generadas por IA en los resultados cuando buscaban personajes históricos. Esto llevó a la difusión de teorías de conspiración en Internet, en particular que Google evitaba deliberadamente mostrar a personas blancas.

¿Qué significa despertar?

En los últimos años, el “despertar” se extendió más allá de las comunidades negras y se hizo popular en todo el mundo. Ahora bien, estar “despertado” significa estar activamente consciente de una amplia gama de problemas sociales, como el racismo, el sexismo y otras formas en que las personas pueden ser tratadas injustamente. A menudo se asocia con personas que tienen opiniones políticas progresistas o de izquierda y con quienes luchan por la justicia social.

A veces, «desperté» se usa negativamente. La gente puede utilizar el Término para criticar a otros por estar demasiado centrados en los problemas sociales. o ser demasiado rápido para denunciar a otros por comportamientos insensibles. También se puede utilizar para dar a entender que el activismo de alguien es falso o que solo le importa la justicia social para parecer moderno.

El error de los blancos de Géminis AI es quizás un sesgo invertido

Las luchas de Google con Gemini resaltan un desafío único en el desarrollo moderno de la IA. Si bien las intenciones detrás de las iniciativas de diversidad e inclusión son loables, la ejecución parece haber compensado en exceso. El resultado es un modelo que parece forzar representaciones no blancas incluso cuando esas representaciones son históricamente inexactas.

Esta consecuencia involuntaria plantea una pregunta compleja: ¿refleja el comportamiento de Géminis un sesgo invertido? Al tratar de combatir la subrepresentación histórica de las minorías, Google ha creado un algoritmo que las favorece desproporcionadamente, incluso hasta el punto de distorsionar figuras históricas conocidas.

Problema habitual, solución inusual.

La situación de Géminis subraya el delicado equilibrio que se requiere al abordar los sesgos en la IA. Tanto la subrepresentación como la sobrerrepresentación pueden ser perjudiciales. Un modelo de IA ideal debe reflejar la realidad con precisión, independientemente de la raza, etnia o género. Forzar la diversidad donde no existe naturalmente no es una solución; es simplemente una forma diferente de prejuicio.

Este estudio de caso debería generar debates sobre cómo los creadores de IA pueden combatir los prejuicios sin crear nuevos desequilibrios. Está claro que las buenas intenciones no son suficientes; es necesario centrarse en la precisión histórica y evitar correcciones excesivas bien intencionadas pero defectuosas.

¿Qué sigue ahora?

Entonces, ¿cómo podría Google mejorar Gemini para evitar que los usuarios hagan preguntas sobre si Gemini AI despertó? Bien:

- Conjuntos de datos de entrenamiento más grandes: Afortunadamente, aumentar el tamaño y la diversidad de los datos de entrenamiento de Gemini podría conducir a resultados más equilibrados e históricamente precisos. Google anunció recientemente Gemini 1.5 Pro

- Énfasis en el contexto histórico: Agregar un mayor énfasis en los períodos y contextos históricos podría ayudar a Géminis a aprender a generar imágenes que reflejen mejor a figuras conocidas.

La IA de Gemini despertó controversia, si bien es un revés, proporciona información valiosa. Muestra que abordar el sesgo en la IA es un proceso continuo y complejo que requiere una consideración cuidadosa, soluciones equilibradas y una voluntad de aprender de los errores.

Crédito de imagen destacada: Jr Korpa/desempaquetar.